Людям постоянно пытаются запретить убивать себя. При Следственном комитете создана межведомственная группа по поиску пропаганды суицида в интернете, общественники проводят вебинары для учителей, где учат распознавать «группы смерти», а Facebook создаёт алгоритмы для распознавания призывающих к самоубийству записей. Самиздат «Батенька, да вы трансформер» рассказывает, как искусственный интеллект учится выявлять суицидальное поведение в соцсетях и почему никого это не спасёт.

Ранним воскресным утром 22 января 2017 года Наика Венант из пригорода Майами запустила свою последнюю трансляцию в Facebook Live. За последний год четырнадцатилетняя девушка сменила четырнадцать приёмных семей и несколько раз безуспешно пыталась восстановить отношения с родной матерью. Около тысячи человек на протяжении более чем двух часов смотрели, как Наика рассказывает, почему решила покончить жизнь самоубийством, затем готовит удавку из шарфа и вешается в ванной комнате дома своих приёмных родителей. Зрители трансляции реагировали по-разному: кто-то пытался отговорить, кто-то издевался над девушкой и называл всё постановкой для привлечения внимания, кто-то в качестве шутки постил видеопародии. По данным местного департамента по делам семьи и детей, мать Наики тоже смотрела трансляцию, но думала, что всё это не всерьёз. Лишь один из зрителей позвонил в полицию, однако по злой иронии дал им неправильный адрес: к трём часам ночи полицейские добрались до места, однако девушка была уже мертва.

Этот случай стал не первой и не единственной трансляцией самоубийства в социальных сетях. Тридцатитрёхлетний актёр из Лос-Анджелеса Фредерик Джей Боуди застрелился в собственной машине во время того как к нему пытались подобраться полицейские. Студент из Мумбаи по имени Арджун Бхарадваж запустил трансляцию и заявил, что записывает «инструкцию, как совершить самоубийство», а через одну минуту сорок четыре секунды выпрыгнул из окна девятнадцатого этажа пятизвёздочного отеля Taj Lands End. Тенденция не обошла стороной и Россию: ещё до всяких «синих китов» и онлайн-стримов СМИ периодически писали о подростках, которые совершили самоубийство, оставив намёки на него на своей странице. Предсмертные записки стало принято писать в интернете.

Для предотвращения самоубийств Facebook в начале марта объявил, что будет использовать искусственный интеллект для определения пользователей на грани суицида и предлагать им поддержку. Социальная сеть содержит подробную информацию о более чем двух миллиардах своих пользователей. Её будут обрабатывать алгоритмы, а затем технология распознавания паттернов будет выделять посты, «с высокой вероятностью содержащие суицидальные мысли», и передавать их команде аналитиков для человеческого вмешательства.

Парой недель позже о подобных планах заявила и российская сеть «ВКонтакте». Правда, там упор делается на анализ изображений: «опасный» контент, по замыслу разработчиков, просто перестанет попадать в ленты пользователей. В первую очередь речь идёт о символах «групп смерти». Страницы авторов «опасных» картинок будут блокироваться: при следующем входе в соцсеть пользователя спросят, что его побудило запостить ту или иную картинку, и в зависимости от ответа направят либо за помощью психологов, либо в службу поддержки.

Попытки научить технологии бороться с суицидом идут довольно давно: ещё в 2007 году группа исследователей из новозеландского Университета королевы Виктории попыталась (довольно успешно) проанализировать записи пользователей MySpace.com, чтобы определить тех, кто находится на грани самоубийства. Среди прочего известно, что алгоритмы машинного обучения гораздо эффективнее профессиональных врачей могут отличить настоящую предсмертную записку от поддельной (78 % точности против 63 %), а на суицидальные склонности может указывать, например, длительность гласных звуков при разговоре. Поиски эти возникают не на пустом месте: как показало недавнее исследование, за пятьдесят лет изучения суицида учёные не добились какого-либо видимого прогресса в его прогнозировании. Традиционные факторы риска, выявленные за прошедшие полвека — депрессия, стресс, употребление психоактивных веществ — обеспечивают точность не выше, чем случайное угадывание. По словам автора исследования, Джозефа Франклина из Университета Флориды, «сведения о предыдущих попытках суицида помогают повысить точность прогноза примерно так же, как покупка второго лотерейного билета помогает выиграть джекпот».

Главной проблемой предыдущих работ считается крайне узкая методология: большинство из них касаются только одного фактора риска и совсем не учитывают комплексности их сочетаний. Сложно представить, чтобы кто-то попытался корректно предсказать вероятность суицида на ближайшие десять лет у отдельно взятого человека, если у него диагностировали клиническую депрессию. А вот такой вариант звучит уже правдоподобнее: клиническая депрессия у пожилого человека, который несколько лет назад потерял жену, имеет доход ниже среднего, ранее совершал попытки суицида и часто посещает врачей из-за многочисленных проблем со здоровьем, может увеличить риск суицидального поведения в течение ближайших нескольких часов, дней или недель. Проблема в том, что подобные сочетания никогда не тестировались в исследованиях — это потребовало бы слишком сложных математических моделей.

Немного теории вероятностей. Основываясь на сухой статистике (уровень самоубийств — тринадцать случаев на сто тысяч человек) и ничего не зная о человеке, можно сказать, что абстрактный житель США совершит самоубийство с вероятностью 0,013 %. Из всех традиционных факторов риска наиболее «сильным» считается предыдущая история попыток суицида: она увеличивает базовую вероятность в 4,2 раза, то есть до 0,057 %. Другой мощный фактор риска, наличие суицидальных мыслей, повысит точность до 0,205 %. Даже чтобы добиться вероятности в 50 %, нужно повысить точность в двести пятьдесят раз и учесть множество факторов, ни один из которых нельзя считать исчерпывающим. К тому же нельзя однозначно говорить о причинно-следственной связи фактора и события: проблемы со сном, которые считаются фактором риска, вполне могут быть всего лишь индикатором более глубоких проблем.

Если подбросить монету и попробовать угадать, орлом она упадёт или решкой, точность прогноза составит 50 %. Предсказание суицида на основе одного фактора даёт точность 58 %. Это примерно соответствует точности прогноза психолога-эксперта, наблюдающего пациента. С помощью компьютера можно достичь точности в 80-90 %.

Одним из наиболее масштабных исследований в этой области стала работа психолога Джессики Рибейро из Университета Флориды. Рибейро занимается проблемой прогнозирования суицида с 2009 года, возглавляет университетскую «Лабораторию идентификации рисков» и работает в том числе с военными ведомствами США, которые также озабочены этой проблемой — ветераны войн относятся к группам с повышенным уровнем самоубийств. Из баз данных нескольких медицинских учреждений исследователи выбрали три тысячи двести человек, пытавшихся совершить суицид. На эти данные они «натравили» алгоритмы машинного обучения, которые выявили комбинации факторов, с наибольшей вероятностью указывающие на суицид. Результаты оказались обнадёживающими: искусственный интеллект смог предсказать, совершит ли человек самоубийство в течение ближайших двух лет, с вероятностью 86 %. На одну неделю вперёд — 92 %.

Конечная цель исследовательской программы Рибейро — разработать систему, которая могла бы с высокой точностью определять риск суицида для любого человека на любом этапе его жизни. Она рассчитывает достичь этой цели в течение ближайших десяти лет. Не исключено, что уже в ближайшем будущем уровень риска суицида можно будет вычислять так же, как уровень риска кардиозаболеваний — что-то вроде шкалы SCORE, но автоматизированной. Эту шкалу будут использовать при разработке системы оповещения для врачей, которая помогла бы им предупреждать и разрешать критические ситуации.

Внедрение таких технологий и систем поставит перед человечеством много новых этических вопросов. Как будет организован доступ к данным пациентов? Что можно считать достаточным условием для вмешательства? Кого оповещать в случае кризисной ситуации? Кроме того, очевидным препятствием на пути внедрения такой модели может стать неравномерное технологическое развитие разных стран. По состоянию на 2017 год, когда проводятся дуэли боевых человекоподобных роботов, человеку вот-вот пересадят голову (или тело, кому как удобнее), а Facebook знает, как часто вы пользуетесь общественным транспортом и сколько у вас непогашенных кредитов… Так вот, по состоянию на 2017 год лишь шестьдесят государств-членов ВОЗ обладают достаточным количеством данных, необходимых для оценки ситуации и корректного прогнозирования.

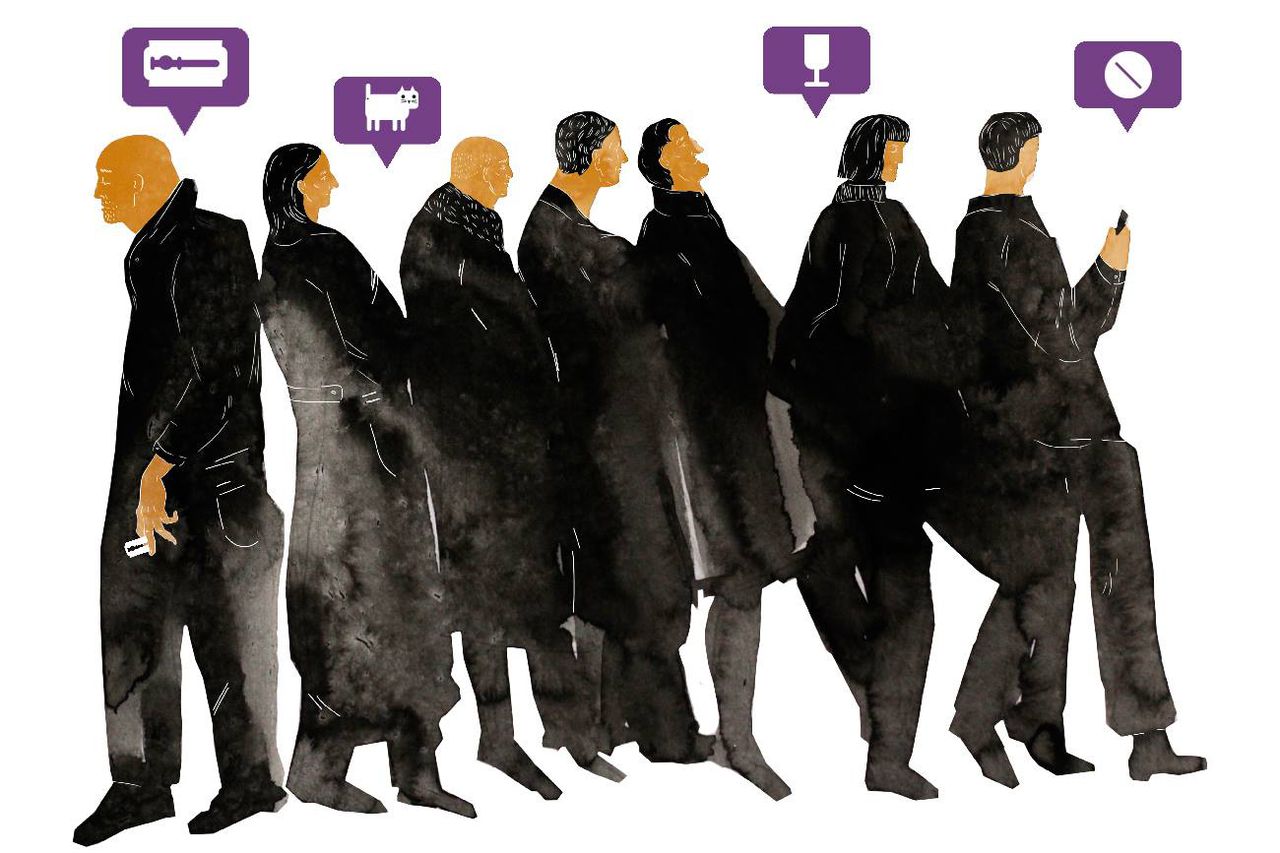

Социальные сети есть везде, но их анализ осложняется тем, что язык там меняется слишком часто. Как выяснила Меган Морено, педиатр из детской больницы Сиэтла, после блокировки в «Инстаграме» одного хэштега, связанного с самоповреждением или суицидом, вместо него появляется сразу несколько новых версий. Например, когда запретили #selfharm, возникли #selfharmmm и #selfinjuryy, а также специфические сленговые варианты — #blithe and #cat. Последними могут пользоваться и обычные пользователи, и любители селфхарма, что вовсе не упрощает задачу искусственному интеллекту.

«Я думаю, машинное обучение всегда будет на шаг отставать от того, как общаются подростки», — говорит доктор Морено. Кажется, чтобы поймать преступника, нужно всё-таки думать, как преступник. Впрочем, учитывая, что искусственный интеллект очень быстро учится всему, что умеет человек, роботы-самоубийцы не заставят себя долго ждать.